Ich muss gestehen, dass auch ich selbst aufgrund des Nofollow-Links etwas an Kreativität eingebüßt hatte. Das Attribut war aber auch zu einfach einzusetzen und da hat man nicht mal gemerkt, dass man ineffizient gearbeitet hat. Aber Google war ja so nett uns das nette Ding wieder wegzunehmen und Schwupps, man merkt wie kompliziert man einfache Probleme gelöst hat.

Warum soll man alle Links, die auf mein Impressum zeigen per Nofollow-Link entwerten, wenn ich gleich die ganze Seite per Meta-Robots auf noindex/follow setzen kann. Ist doch viel einfacher und ruck zuck verteilt sich die ganze auf der Impressumsseite angesammelte Linkpower auf die von dort angelinkten Seiten. Und es ist so viel leichter…

Jetzt aber mal weg von der Einzelfallbetrachtung. Im vorherigen Posting hatte ich das grundsätzliche Ziel bereits beschrieben. Kurz, der interne Linkgraph soll auf die Seiten fokussiert werden, die auch vom Nutzer angefragt werden. Dabei habe ich folgende Methoden für die Lösung dieser Aufgabe vorgeschlagen:

- Entwertung der Links die auf die Seite zeigen durch

- Einsatz von IFrames

- Einsatz von Ajax/Javascript

- Entwertung der ganzen Seite

- Meta-Robot

- Canonical-Tag

Die Methoden der Linkentwertung habe ich auch hinreichend beschrieben, weswegen wir uns jetzt den Methoden der Entwertung der Seiten zuwenden.

Entwertung von Seiten

Hier gehen wir davon aus, dass es Seiten gibt die für Nutzer von Google irrelevant sind. Das sind alle Seiten, die keine Frage beantworten können, die ein Nutzer von Google stellt. Somit ziehen diese Seiten Rankgewicht von den Seiten ab, nach denen Nutzer in Google suchen.

Somit hängt die Entscheidung welche Seiten betroffen sind immer davon ab, welches Ziel ich verfolge. Nehmen wir das Beispiel Impressum. Wenn ich ein Onlineshop bin, wird kaum jemand über Google nach meinem Impressum suchen. Die Seite ist also für die Nutzer von Google uninteressant und ich kann sie entwerten. Bin ich aber ein Ladengeschäft und habe meine Adresse nur auf meinem Impressum hinterlegt, ist diese Seite sehr wohl für Nutzer von Google von Interesse. Ich sollte mir aber überlegen, ob ich die Seite lieber in Anschrift umbenenne. Ich hoffe aber, dass das Prinzip klar geworden ist.

Die beiden Methoden unterscheiden sich hinsichtlich der zusätzlichen Funktionen der Seite.

Meta-Robots

Der Einsatz vonempfiehlt sich bei allen Seiten, die man wegen rechtlichen Gründen anbieten muss (z.B. Impressum, AGBs etc.). Idee ist, dass die Seite nicht indexiert werden soll (NOINDEX), den Links auf der Seite aber sehr wohl gefolgt werden soll (FOLLOW). Die Hoffnung ist, dass sich das angesammelte Linkgewicht auf verlinkten Seiten vererbt. Man leitet die Linkpower also einfach durch diese Seiten auf die Zielseiten.

Es gibt aber noch andere Seitenartefakte, die vor allem bei größeren Seiten auftreten: Paginierungen von Archiven.

Das Problem bei Paginierungen ist, dass nur die erste Seite für Nutzer aus Google relevant sind. Das sieht man auch daran, dass Google in den Webmastertools die doppelten Titel von Archiven kritisiert. Wenn man aber einfach die Seitenzahl in den Titel übernimmt, wird man merken dass es keine Suchanfrage in der Form „Zweite Seite zum Thema X“ gibt. Sprich, die zweiten und folgenden Seiten eines Archivs beantworten keine Frage, die ein Nutzer an Google stellt.

Allerdings enthalten sie wertvolle Links auf Artikel, womit sie für den internen Linkgraph wichtig sind. Somit eignet sich die Entwertung der Seiten perperfekt. Die Seiten werden aus dem Index genommen, der Linkgraph bleibt aber intakt.

Als Beispiel verweise ich auf unsere Schauspielerarchive bei Videoload. Hier Sandra Bullock

Canonical-Tag

Das Canonical-Tag ist dafür gedacht doppelte Inhalte zusammenzuführen. Man kann es aber auch sehr gut dazu verwenden, um sogenannten Near Duplicate Content zu vermeiden. Die oben angesprochenen Paginierungen von Archivseiten könnte man auch per Canonical-Tag zurück auf die erste Seite verweisen. Da ich aber noch nicht getestet habe, ob Google dann dennoch die Links auf der Seite auswertet, setzen wir das Canonical-Tag in diesen Fällen nicht ein.

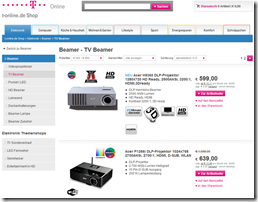

Es gibt aber andere Artefakte, die sich für den Einsatz vom Caninical-Tag eignen. Diese finden sich oft bei Seiten, die über Filter oder Sortierfunktionen verfügen. Als Beispiel dient mir hier der T-Online Shop. Hier folgende Seite:

Das bedeutet also, dass die URLs die durch diese Filter erzeugt werden, wieder keine Frage beantworten die ein Googlenutzer an Google stellt. Da wir aber bereits alle Beamer über die Paginierungsseiten angelinkt haben, sind diese durch den Preisfilter erzeugten Seiten für Google und den internen Linkgraph wertlos. Man kann sie also schlicht per Canonical-Tag auf die Kategorie TV-Beamer weiterleiten.

Ähnlich verhält es sich mit Sortierungen. Auch diese Seiten kann man ohne Probleme per Canonical-Tag auf die jeweilige Default-Version der Seite umleiten lassen. Sprich jede Seite, die für die Nutzer meiner Seite wichtig aber nicht für Nutzer von Google relevant sind, kann man per Canonical-Tag auf die jeweils Google-relevante Version verweisen lassen.

WICHTIG: Hierbei aber bitte unbedingt prüfen, ob die Filter wirklich nicht relevant sind.

Im Beispiel der Beamer sind die Filter nach Marke durchaus suchrelevant, weshalb die Seite zu TV-Beamern von Acer nicht per Canonical-Tag auf die Seite der TV-Beamer ohne Herstellerfilter verweist.

Nachfolgend noch eine tabellarische Übersicht zum Themen:

Zum Abschluss bleibt mir nur zu hoffen, dass Euch diese kleine Serie gefallen hat. Und natürlich interessieren mich Eure Methoden zur Fokussierung des internen Linkgraph. Fragen, Kommentare und Anmerkungen sind willkommen. Also los!

Schreibt Eure Fragen einfach an: [email protected]

Lest auch Teil I – Linkfokussierung I : Linkentwertung

(Bild: Stock Photo ID: 52131652 Copyright: VLADGRIN)

Es handelt sich hier um die Kategorie TV-Beamer, die aber per Filter auf Beamer von 500,00 € bis 800,00 € eingeschränkt ist. Nun sind aber selbst uns die Suchanfragen nach Beamer von 500 bis 800 Euro zu longtailig 😉

Es handelt sich hier um die Kategorie TV-Beamer, die aber per Filter auf Beamer von 500,00 € bis 800,00 € eingeschränkt ist. Nun sind aber selbst uns die Suchanfragen nach Beamer von 500 bis 800 Euro zu longtailig 😉